AI能力的侷限 底牌和命門 20240927,這系列講萬維鋼老師的『拐點』,這次在第一章第三節討論AI能力的局限,並且提出我自己的想法。包括:AI的局限性、AI的無意圖性,以及對人工智能「脫離控制」的假設,我對於此矛盾的反饋,以及認為風險應該來自人類,AI非威脅但足以毀滅一事。

AI能力的侷限 底牌和命門 影片

嗨我是亞瑟我有三高

今天要來講AI能力的局限

底牌和命門

這個系列我們在講萬維剛老師的拐點

而這一次我們在第一章第三節

這一次會討論AI能力的局限

以及提出我自己的想法那我們就開始吧

AI能力的侷限 底牌和命門

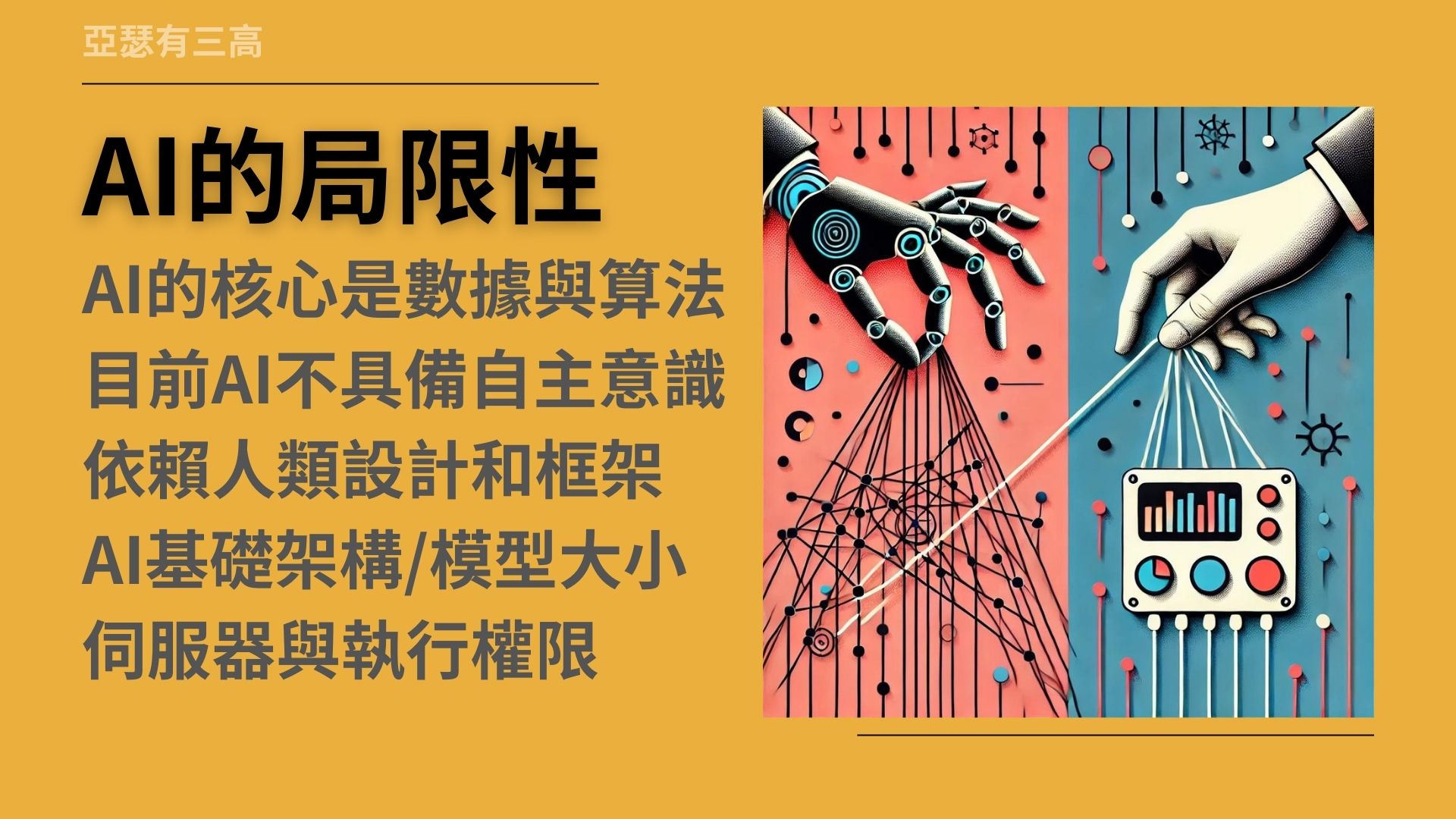

- AI的核心是數據與算法

- 目前AI不具備自主意識

- 依賴人類設計和框架

- AI基礎架構/模型大小

- 伺服器與執行權限

在書中,萬維鋼老師介紹了AI的核心能力和限制。他指出,AI主要依賴於大量的數據和預設的算法運行,這些算法可以讓AI處理複雜的數據,做出一定的預測或決策,但這並不代表AI具備真正的智能或自主性。AI的一切行為都受到人類設計和控制的約束,無法脫離這一框架。

那些框架﹔AI基礎架構、模型參數大小、預訓練資料、訓練資料庫、人類修正的品質、訓練與推論的伺服器、模型執行的權限、AI控制的硬體範圍。

AI的無意圖性

- AI行為依賴數據和算法

- AI無法形成自主意圖

- 受限於既有技術框架

https://zuniseason.org.hk/z-live/writing-with-ai/

萬維剛特別強調了AI沒有「意圖」。這意味著,AI只是根據輸入的數據和算法做出回應,無論它的表現多麼令人驚豔,它仍然是工具,無法像人類一樣進行自主決策或創造。它的所有行為都是基於預設程序,並不具備自發意識。

人工智能無法自行進行推理,也沒有真正創造的能力,更難自行進步與升級,都是依賴人類的指令進行。

同樣的概念,我們也在前面「姜峯楠 AI不是真的藝術」,提到AI沒有意圖的這件事情,有比較長篇幅的討論,可以點進去了解。

不受控制的矛盾

- 「脫離控制」的假設

- AI無意圖性存在矛盾

- 無法突破人類設計的框架

- 依然受限於算法和數據

《拐點》書中同時強調了,兩個應該是互相矛盾的觀點:一方面,AI是依賴於數據和算法的工具,沒有自主意圖,也無法自行進行推理或創造;另一方面書中又提到,AI可能脫離人類的控制,甚至會做出不受預測的行為。

這裡就有一個明顯的矛盾。既然AI的運作,依賴於人類設定的數據和算法,並且沒有形成自主意圖的能力,那麼它如何可能自行脫離控制?

因為AI無法像人類一樣,有意識的、自發性地突破限制。無論AI的表現多麼強大,它仍然只是一個工具,行為受到原本設定的程序,和人類給予的框架約束。

目前我認為,「AI脫離控制」的觀點並不立刻成立,至少在眼前的世界中,AI的行為取決於它被如何設計和使用。我們所看到的不可預測性,更可能是由於數據太複雜,導致我們不理解內部運作的方式,而不是AI自行突破了人類的控制。

當然如果未來有一天,AI有生物腦輔助的情況下,可能就不再受人類的控制了。

風險來自人類

- AI的確有潛風險

- 人類設計的錯誤或誤用

- 脫離控制來自於人類

- 而非AI本身的意圖

- AI目前還是輔助工具

https://www.ey.com/zh_tw/financial-services/artificial-intelligence-ai-global-regulatory-landscape

AI真正的風險來自於我們人類自己。AI本身沒有意圖,也不會自發產生「惡意」行為。未來的問題可能源自於人類設計不當,或者是AI被錯誤使用的情況。

這與萬維剛老師在書中所提到的「AI可能脫離控制」的假設相對應,但事實上,現有的AI技術仍在可控範圍內。AI只是工具,它如何被用來決策和行動,仍然由人類決定。

隨著人類逐步把基本決策交由AI處理,而機器的想法和人不同時,有可能出現人工智能做出難以理解的問題。

例如﹔為了整體交通順暢,AI可能會阻擋大量車輛上路,延遲15分鐘後才開始運輸,這就會大大與人類的想法相左,單獨的人類更傾向在路上慢慢塞,而不是被迫停在車庫發呆。

非威脅但足以毀滅

- AI是工具沒有自主意圖

- 工具可以造成毀滅性後果

- 當AI大量部署出錯時

- 可能導致巨大傷亡和破壞

- AI不是人類心智

https://www.bbc.com/zhongwen/trad/world-69355830

AI作為工具,在大規模應用於社會中的時候,當它出錯或被錯誤使用時,後果可能是毀滅性的。

智慧型工具本質上是中立的,但由於它依賴演算法運作,當它的數據、規則或設計有瑕疵時,AI的錯誤可能會迅速擴大。尤其是在應用於醫療、交通、軍事等高風險領域時,AI的錯誤決策可能會導致大規模傷亡。

若AI在自動化戰爭系統中出錯,或在醫療系統中做出錯誤診斷,這些情況可能會造成,難以挽回的傷害和大量死亡。這些後果或許不輸毀滅性的武器,因為AI的錯誤決策能在瞬間執行,立刻釋放出巨大的破壞力,而且沒有人類的「善意」或「惡意」的概念去抑制這些行為。

這裡的延伸閱讀是對真主黨的攻擊,人類執行一個按鍵,造成數十人死數百人傷,還會傷及無辜孩子與百姓,人類最終有可能會收手,但這樣的良好「效果」,AI應該會評估有效並繼續執行。

更嚴重的AI不是人類,沒有人類先天的懦弱跟膽怯,在做錯事的時候並不會收手,不會心軟、不會殺紅眼,無法共情傷者的痛苦與煎熬,這才是未來最大的威脅。

對於這個部分,我會再做一集來做延伸,談論AI可能會擴大我們人類的缺點的問題,那我們就下次見~掰掰。