博通股價大漲 AI客製晶片 2024216,今天要談的是博通客製化晶片大賣的消息,盤後股價大漲24%,這次要深入分析博通的AI晶片,了解它的技術優勢和市場表現。隨著人工智能推論的應用擴展,博通的技術領導地位逐漸顯現,尤其是XPU晶片,讓我們來看看它的優點和挑戰吧。

博通股價大漲 AI客製晶片 影片

嗨我是亞瑟我有三高

今天來講博通大漲

因為客製化晶片爆棚啦

今天日期是2024年12月16號

坦白說這下真的是要三高爆發了

因為我自己竟然完全不知道

博通在客製化的AI晶片上面

已經有這麼高的突破

這麼多厲害的東西

導致它盤後大漲24%

而這個我竟然沒有追到

哇 氣死我 真是氣死我

那麼這一集我就要好好來分析研究

博通 Broadcom 它的AI晶片到底是什麼

而且為什麼可以攻城掠地這麼厲害

所以這一集會很硬 內容會很多

不好意思 因為這就是我的研究報告

博通財報表現佳

- 2024年博通財報驚喜

- AI成為業績增長關鍵

- 佈局AI策略展現成果

- 技術拓展至資料中心

- 生成式AI需求推動業績

2024 年,博通的財報表現非常突出,尤其是 AI 部門的營收,讓市場刮目相看。根據最新數據,博通在 AI 領域的收入達到了 122 億美元,成為該年度業績增長的重要推動力。不僅如此,這樣的表現也直接提振了市場對博通的信心,讓股價快速上漲。

博通作為晶片領域的技術領導者,早在幾年前就已經開始佈局 AI 推論運算。而這次財報數據顯示,他們的策略正在開花結果。隨著生成式 AI、深度學習等應用快速擴展,博通的技術優勢已不再局限於網路基礎設備,而是進一步拓展到資料中心和 AI 應用,為企業提供了更多新的可能性。

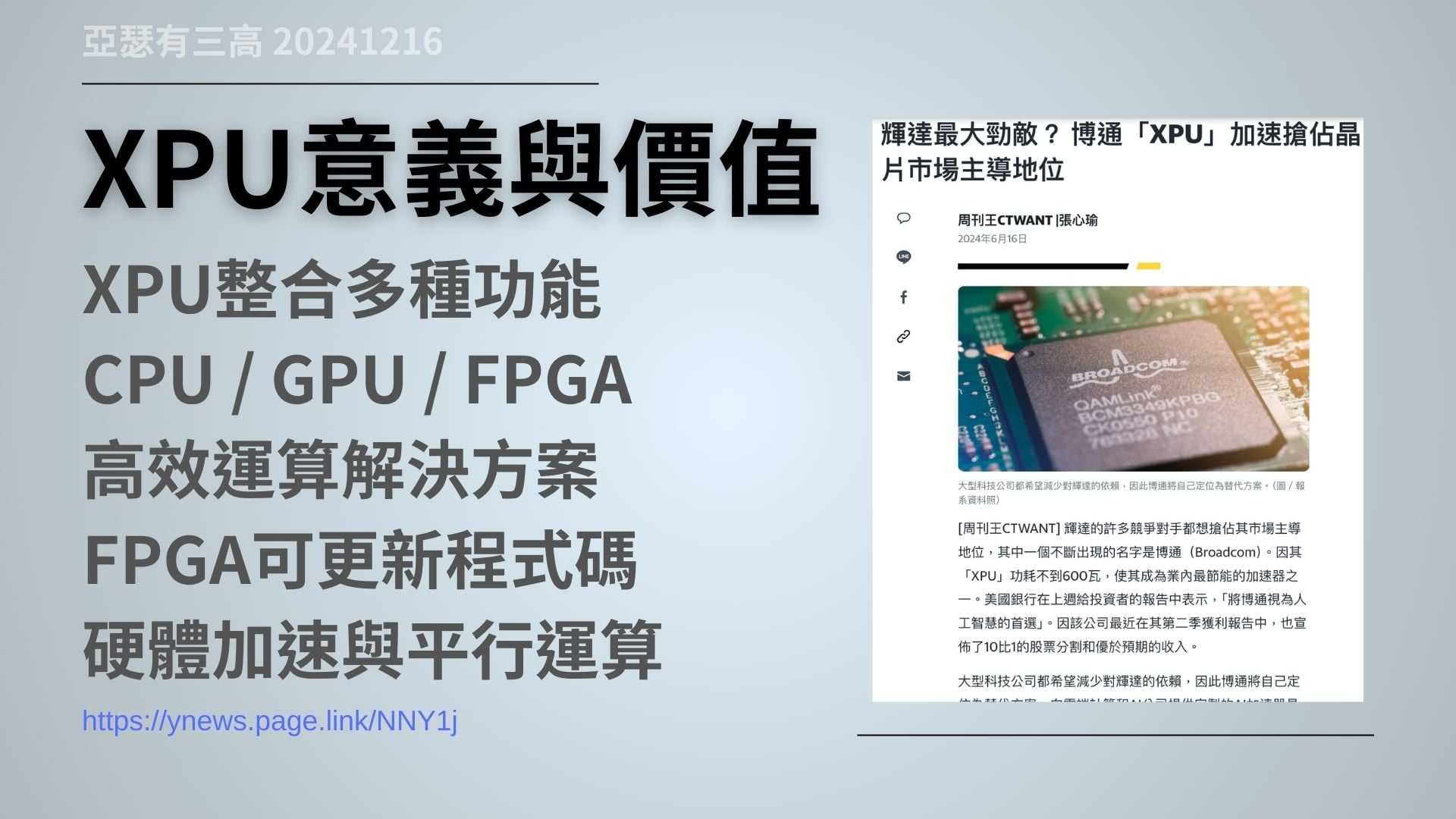

XPU意義與價值

- XPU整合多種功能

- CPU / GPU / FPGA

- 高效運算解決方案

- FPGA可更新程式碼

- 硬體加速與平行運算

什麼是 XPU?簡單來說,它是一種專為 AI 和高效能運算量身設計的處理器架構,全名是 可擴展處理單元(eXtensible Processing Unit)。XPU 的設計理念就是將 CPU、GPU 和 FPGA 的功能整合在單一晶片上,結合三種技術的優勢,針對不同的應用場景提供高度客製化的運算方案。

這種設計最大的特色是靈活、高效。XPU 不僅具備 CPU 處理邏輯運算的能力,也能利用 GPU 的平行運算功能處理大量數據,同時還能透過 FPGA 提供『針對性』硬體加速計算。

FPGA晶片生產完成之後,仍然可以也更新新的程式碼,具有非常高的靈活性和客製化能力。FPGA可以在製造後反覆重設定,讓設計人員能夠快速修改和更新,縮短開發週期並降低成本。

FPGA讓XPU有長期可用性和可升級性,能夠適應不斷變化的技術,也擁有強大的傳統CPU運算能力,與GPU的AI平行運算能力。為資料中心和 AI 應用帶來了更多發展機會。

XPU AI推論優勢

- XPU整合消除數據延遲

- 單顆晶片功耗不到600瓦

- 內建FPGA模組靈活調整

- 適應生成式AI運算需求

- 模組化設備整合

https://www.sigarch.org/a-brief-guide-of-xpu-for-ai-accelerators

XPU 之所以能在 AI 推論市場中展現優勢,主要有四大特點:

第一,整合架構,降低延遲。

XPU 將 CPU、GPU 和 FPGA 的功能全部整合到單一晶片上,不需要數據在不同晶片間來回傳輸,這大幅縮短了延遲時間,特別適合即時處理的應用。

第二,高能效,降低運行成本。

根據博通的內部測試,XPU 晶片的功耗不到 600 瓦,在 AI 市場中是能效表現最好的選擇之一。這對需要大量算力、但同時也在意能源消耗的資料中心來說,是非常有吸引力的。

第三,彈性設計,適應性強。

XPU 的內建 FPGA 模組,能根據不同場景進行硬體層的動態調整。特別是生成式 AI 和即時推論這類需求變化快速的應用場景,XPU 的靈活性讓它能輕鬆應對挑戰。

第四,可與現有設備整合

由於大量模組化的原因, 可以和原有的設備互相連結,甚至可以重新組成新的預算節點,讓業者有更大的靈活性,可以節省大量的成本,而不必浪費舊的設備。

XPU侷限與挑戰

- 軟體生態不足

- 市場滲透率低

- 部署成本高

- 應用場景狹窄

- 生態建設不足

https://www.networkoptix.com/blog/2024/03/05/introducing-the-open-ai-accelerator-standard

儘管博通的 XPU 技術在硬體設計和能效上表現突出,但仍面臨幾個重要侷限。

軟體生態系統不足,是最主要的挑戰。相較於 NVIDIA 成熟的 CUDA 平台,博通缺乏完善的開發工具與環境,提高開發者和企業的轉換成本。

其次,市場滲透率有限。目前 XPU 雖打入 Google、AWS 等大型客戶,但在中小型企業中接受度低,難以快速規模化。初期部署成本高 ,也讓阻擋許多潛在客戶,因為 XPU 的客製化設計,需要重新調整系統和程式,增加了資金與時間負擔。

最後,博通 XPU 聚焦於推論運算,應用場景相對狹窄,在生成式 AI 訓練,仍難以匹敵 NVIDIA 和 AMD 的專業晶片。未來若無法構建更成熟的生態系統,博通可能面臨硬體能力強,但市場吸引力不足的風險。

博通成功因素

- 博通擁有深厚ASIC經驗

- 配合客戶設計專屬方案

- 結合網路相關機房技術

- 模組化設計提升靈活性

- 降低升級成本擴展性強

博通能在 XPU 市場迅速崛起,成功的背後有以下幾個重要原因:

第一,ASIC 設計技術深厚。

博通在 ASIC 晶片設計上擁有多年的累積經驗,能快速針對超大規模雲服務商(如 Google、AWS 等)提供高度客製化的解決方案。

第二,生態整合能力完整。

博通不僅提供 XPU 晶片,還結合了自家的交換機技術,形成一套完整的資料中心解決方案,直接滿足企業對運算與網路的綜合需求。

第三,模組化設計,提升靈活性。

XPU 採用模組化的生產方式,讓它能輕鬆整合到現有的機房或網路架構中,甚至可以直接配合原本的伺服器內部設計。這不僅提高了客戶升級的靈活性,也降低了整體成本。

NVIDIA AMD

- NVIDIA全年約1200億美元

- 博通全年營收516美元

- AMD全年營收約268億美元

- XPU表現突出適用推論場景

- 對比表列出三家功能差異

https://www.digitimes.com/reports/ai/2024_ai_chip

2024 年,NVIDIA、博通和 AMD 在 AI 晶片市場中各有策略,以下是它們的營收和產品特性比較:

NVIDIA:全年營收預估 1,200 億美元,其中超過70%- 800億,來自 AI 晶片和資料中心業務,為市場領導者。

博通(Broadcom):全年營收 51ˊ 億美元,AI 晶片收入為 122 億美元。

AMD:全年營收預估 268 億美元,AI 晶片收入為 50 億美元。

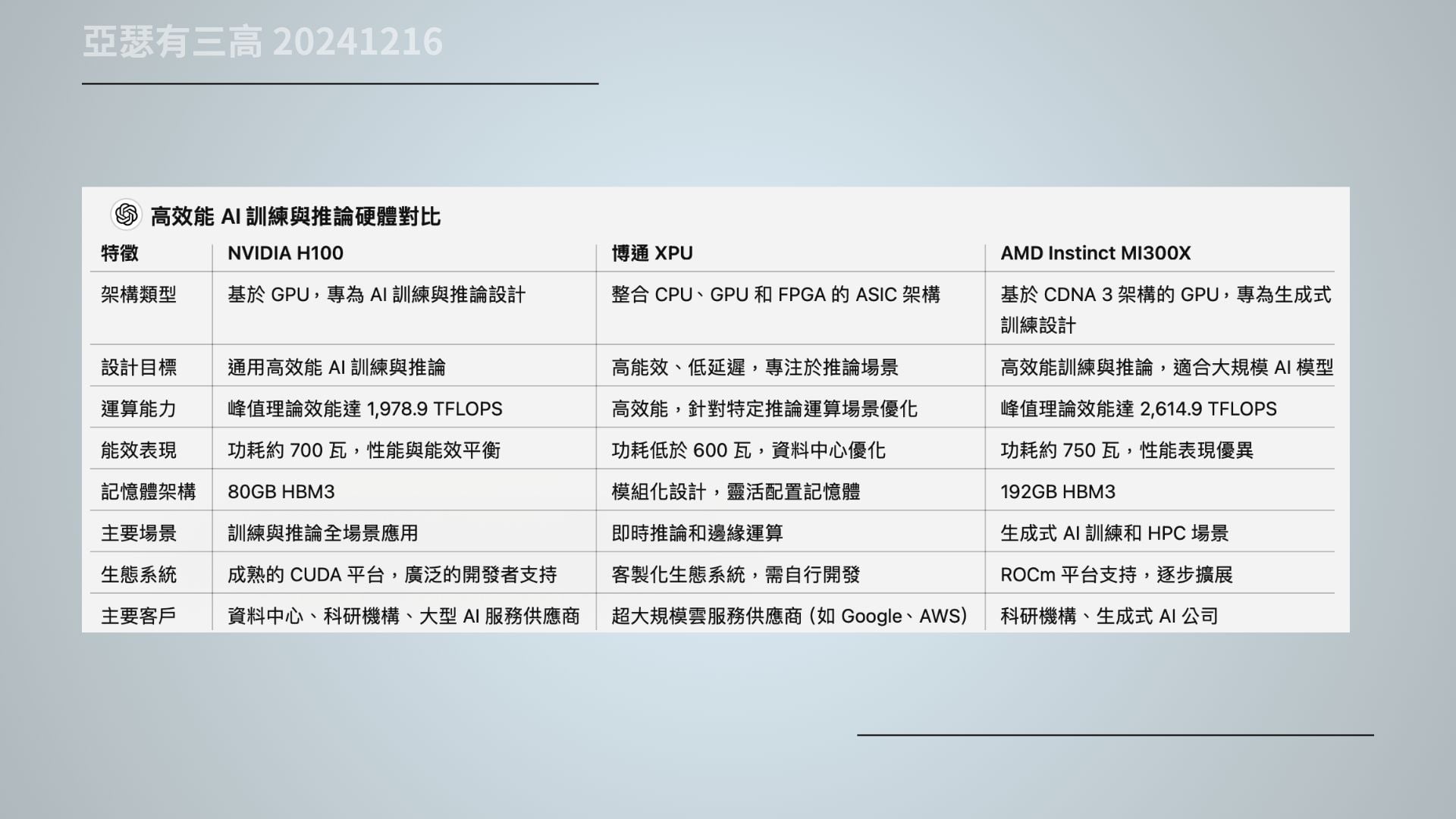

在這邊我提供了一張我自己做出來的整理表

目前NVIDIA的H100 博通的XPU跟AMD的MI300X

它本身的架構跟場景運用的不同

給各位做一個參考

比較重要的部分是

H100跟MI300它都可以適用於訓練AI

但是博通的XPU是適用於推論

就是運用AI

這導致了博通不管再努力也無法到訓練AI的部分

這部分是它目前天花板的上限

這要稍微留意一下

另外它的平台生態系統目前還不夠成熟

CUDA目前真的是一方獨大

暫時還沒有人能夠挑戰它

AI客製晶片爆噴

- 博通聚焦AI推論成功

- 大型客戶深度合作

- 結合FPGA與ASIC架構

- 博通針對大客戶客製化

- CUDA生態挑戰仍存在

https://finance.yahoo.com/news/broadcom-unveils-tech-speed-custom-140241416.html

博通這次在 XPU 市場的成功,充分展現了它「默默耕耘、精準突破」的策略。當市場目光集中在 NVIDIA 與 AMD 的競爭,或 Intel 的爭砸時,博通已經悄悄透過,與大型客戶的深度合作,開發出一套完全不同於 CUDA 的模式。

相較於 NVIDIA 和 AMD 提供的標準化產品,博通強調以 FPGA 彈性設計為基礎,結合其整合的 ASIC 架構,針對AI推論,打造高度客製化的運算解決方案。這樣的策略不僅讓博通降低功耗,也讓雲服務供應商,可以在現有設備上快速提升運算效能。

雖然博通在客製化設計中脫穎而出,但 NVIDIA 的 CUDA 生態系統,仍是市場上最成熟的解決方案,大量的開發工具與軟體程式內容,是博通未來需要面對的挑戰之一。

然而,博通將目標精準地鎖定在 AI 推論領域,而這次策略的成果不僅展現在數據中,更體現在它日益穩固的市場地位。