Apple的AI 早就超前部署 20240610,蘋果在AI領域中,早就偷偷部署好多年,包括:電腦NPU早內建、語音辨識翻譯、蘋果CPU暗藏玄機、電腦叢集拼效能、手機NPU早內建,推測蘋果已經AI就緒, 只要軟體更新,就立刻讓目前市場大多數的蘋果設備,直接擁有A I能力。

Apple的AI 短片

Apple的AI

嗨~我是亞瑟,我有三高

今天的日期是2026年6月10號禮拜一

今天是端午節所以不上班

股市也一樣沒有開市

今天要談的主題是

Apple的AI早就超前部署

會談這個議題很重要的原因是

前幾天股癌謝孟恭

談了Apple的AI問題

而Apple的開發者大會

在明天的凌晨應該就要開始了

應該會部署一些AI的東西

所以這個影片不得不在

今天錄完並上架

不能趕在Apple發表會之後

不然就變成後見之明

那就不好玩了

電腦NPU早內建

- 2020 M1-11 tops

- 2022 M2-16 tops

- 2023 M3-18 tops

- 2024 M4-38 tops

蘋果的電腦

早就把NPU內建在CPU裡面了

M1晶片就已經

可以運作最基本的AI運算

在2020年初的M1

它有11 TOPS的運算力

2022年的M2變成16 TOPS

2023年的M3變成18 TOPS

而現在2024年的M4

不僅已經達到38 TOPS

語音辨識翻譯

- 4年前的M1

- 使用Macwhisper

- 足以即時語音辨識

- 足夠GPT本地翻譯

- 能跑簡易語言模型

讀到這裡一定有人會問

TOPS到底代表什麼意義呢

我舉一個我自己電腦的例子來說

我有一台四年前的

M1 CPU的MacBook

裡面的AI計算能力是11 TOPS

之前我做了一個實驗

使用了一個叫MacWhisper的軟體

去跑語音辨識

我發現一分鐘的中文影片

要辨識它的速度其實不到一分鐘

大約五十幾秒就可以辨識完畢

也就是說11 TOPS的

NPU運算能力

已經足夠我們在本地進行

最基本的語音辨識

可能GPT-3.5的模型

也能幫你做些修正

所以11 TOPS已經足夠

跑簡易的語言模型並且做出反應

蘋果CPU暗藏玄機

- 記憶體放在CPU中

- M3 MAX 最多128G

- 媲美H100的80G

- AI運算速度雖慢

- 但能運行大型模型

更令人驚訝的是

蘋果在CPU裡面隱藏

更深入更先進的一些秘密

例如在CPU旁邊已經放了記憶體

直接封裝在一起

這好處是速度非常快

而且可以直接調用龐大的記憶體

以目前量產的M3 CPU來說

它最多可以放128GB的記憶體

比目前NVIDIA的

H100的80GB還要大

雖然比H100慢很多

但至少可以運行大型模型

電腦叢集拼效能

- MacMini裝M4進階版

- 記憶體上看128G一台

- 每台10G網路架叢集

- 便宜 好修 省電 氣冷

- 2009-2014 Mac Mini Server

接下來談談

蘋果對於伺服器未來的打算

我認為它也做好了前瞻的部署

如果蘋果在Mac mini裡面

裝入M4 CPU的進階版

每一台M4 CPU放128GB的記憶體

而且每一台機器還配有10Gb的網路

我只要用很多Mac mini

一排排全部排起來串成電腦叢集

那就可以成為一個

很有用的AI伺服器了

這樣的Mac mini伺服器

強大又便宜

因為是蘋果自己做的

毛利低 好修有問題直接換就好了

省電Mac省電大家都知道

在來它是氣冷不用水冷

蘋果不是沒做過這樣的事情

在2009年到2014年之間

蘋果就曾經發表過

Mac mini Server

現在NVIDIA把伺服器賣得這麼貴

是不是蘋果又可以把

這一招拿出來用打個幾年呢?

所以市場上很明顯地看到

蘋果下了非常多

M系列CPU的單子給台積電

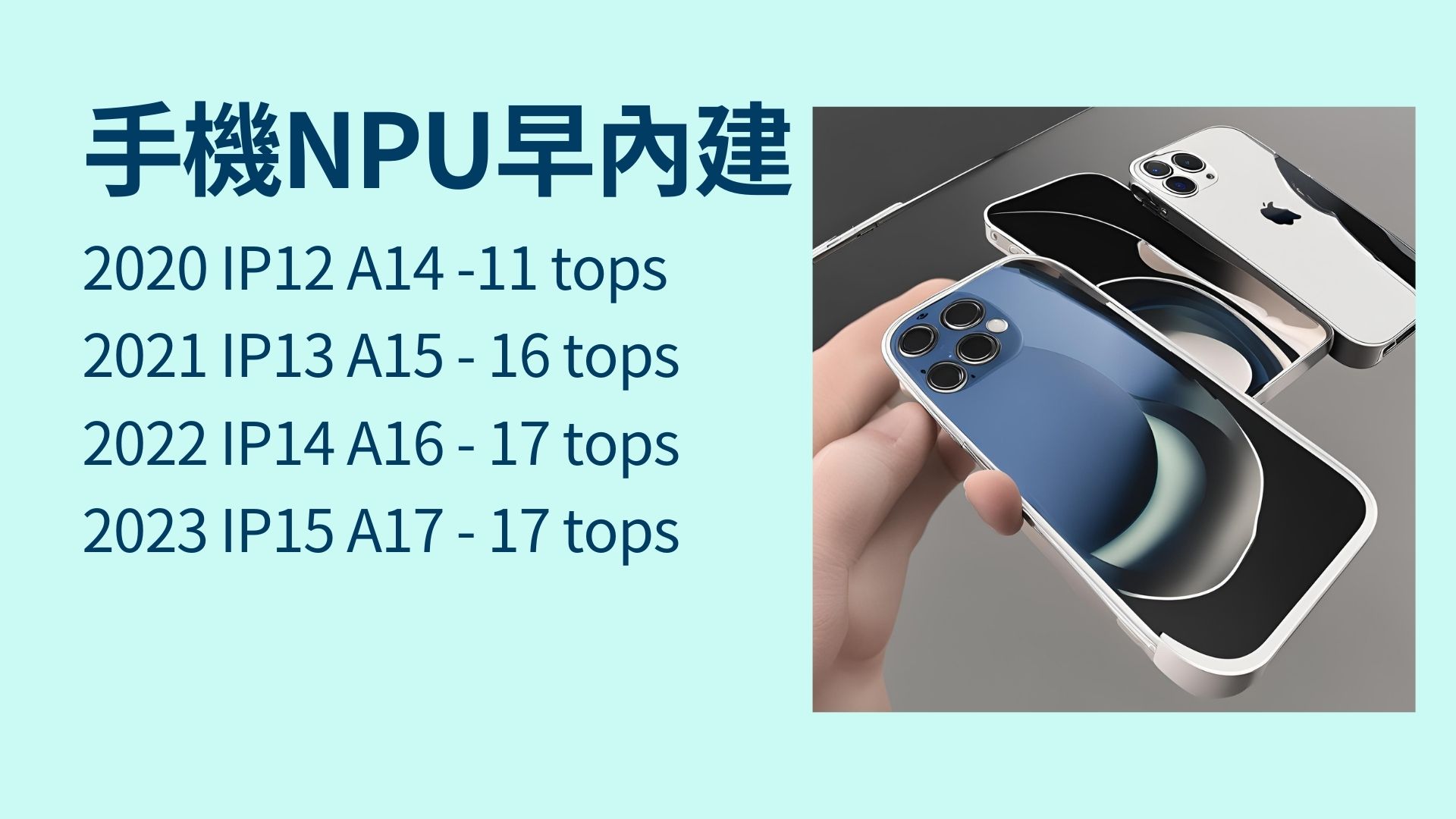

手機NPU早內建

- 2020 IP12 A14-11 tops

- 2021 IP13 A15-16 tops

- 2022 IP14 A16-17 tops

- 2023 IP15 A17-17 tops

蘋果不僅在電腦上做這樣的安排

更早之前的手機也做了這樣的安排

早在2020年出的iPhone 12

配的是A14那台手機就有

11 TOPS的運算能力了

現在的iPhone 15配的是A17

它有17 TOPS的AI運算能力

也就是說我們的手機

如果要變成AI手機

其實蘋果只差一步

那就是軟體更新

蘋果已經AI就緒

- 舊手機電腦至少11 tops

- 軟體升級就能跑小模型

- H100算力495tops $100萬

- 新M4晶片AI算力38tops

- 造價便宜又能串連多台

- 大模型訓練用伺服器

所以我要談的是

蘋果的AI其實早就已經準備好了

至少過去四年內的舊手機舊電腦

至少都有11 TOPS的運算能力

只要軟體升級就可以跑小模型

目前NVIDIA的H100

算力有495 TOPS非常厲害

但一張卡就要100萬

假設M4晶片的AI算力

不要提升就38 TOPS就好

M4晶片組出的Mac mini叢集成本更低

可以用20台過H100一張的速度

多用幾個M4的Mac mini

就可以做出非常有力的

蘋果AI伺服器

我們一般的中小企業

不需要訓練大模型

通常只需要用小模型做運用

所以也許用一台M4

或是10台20台M4

做出一個夠力的

AI運行伺服器就夠用了

所以我覺得蘋果早就準備好了

今天到這裡~掰